2026年,我如何用自动化流水线将SaaS博客生产效率提升10倍

寫這篇東西的時候,我剛處理完一個「小」事故。我們一個面向東南亞市場的產品功能頁,因為一篇自動發布的博客裡某個本地化術語的細微偏差,在社交媒體上引發了一小波討論。這讓我想起三年前,我們還在為每週能穩定產出兩篇英文博客而掙扎。從那時的手忙腳亂,到如今依賴一套近乎自治的系統管理著跨越五個語言、數十個主題的博客矩陣,中間踩過的坑和迭代的思路,或許比最終那個漂亮的「10倍效率」數字更有價值。

從「寫什麼」到「從哪裡來」:內容源的範式轉移

早期我們的內容生產流程非常經典:市場部提需求,SEO團隊給關鍵字,然後就是寫。瓶頸很快出現:關鍵字庫迅速枯竭,寫手陷入重複勞動,內容同質化嚴重,流量增長很快觸頂。我們意識到,問題不在「怎麼寫」,而在「寫什麼」。高品質、持續的內容生產,首先必須解決「源」的問題。

我們嘗試過讓寫手去扒行業報告、看競品博客、甚至總結YouTube影片。結果呢?人力成本飆升,產出不穩定,質量參差不齊。一個寫手花一上午看影片、做筆記、再成文,效率低下,且嚴重依賴個人能力。這根本不是可規模化的SaaS做法。

轉折點在於我們開始系統性地將內容源分類,並尋找自動化處理的可能性。我們把源分為四類:

- 核心關鍵字:SEO的基石,但需要拓展外延。

- 行業趨勢與熱點:來自新聞聚合、社交媒體討論和特定論壇,追求時效性。

- 影片/播客內容:YouTube、行業研討會錄像,信息密度高但提煉費時。

- 競品與關聯產品頁面:分析對方的表述角度、功能重點和用戶評論。

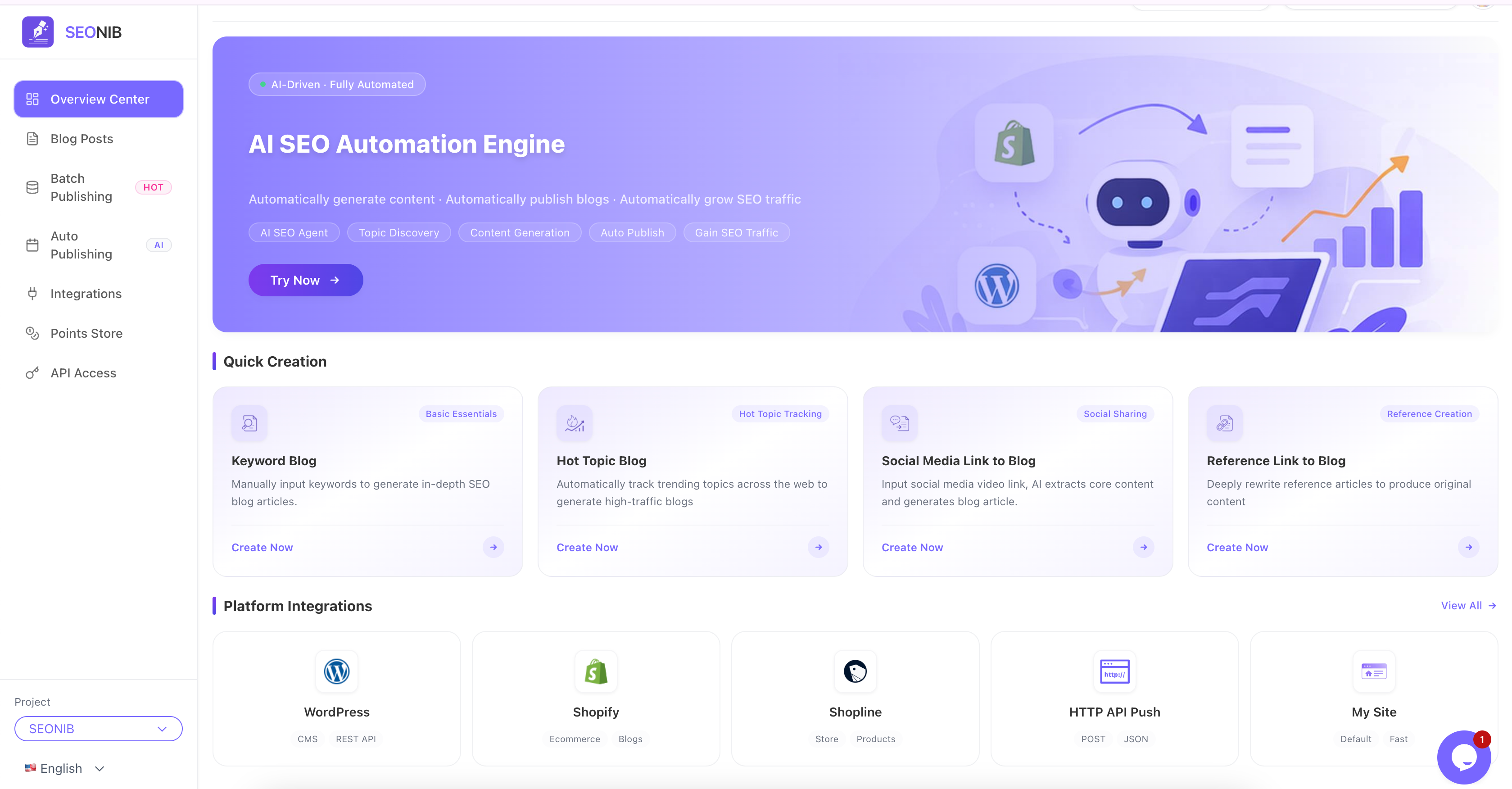

手動處理這四類源是災難。我們需要一個能理解這些不同格式的輸入,並能提取核心主題、觀點和事實,進而組織成文的「中間件」。這正是我們引入 SEONIB 的起點。最初只是試驗性地讓它解析幾個競品頁面和YouTube連結,生成草稿。沒想到,它不僅能提取關鍵信息,還能識別出原影片中口語化表達的要點,並重組為結構清晰的博客段落。這讓我們看到了將「信息消化」環節自動化的可能性。

「批量生成」不是魔法:配置、質量與風險的平衡術

一旦解決了「源」的問題,很自然就進入下一個階段:批量化。但「批量生成」聽起來很美好,實操起來卻滿是細節。最大的誤區是認為「配置一次,一勞永逸」。 現實是,批量生成的質量,完全取決於初始配置的精細度和對生成邏輯的理解。

我們犯過的錯包括:

- 主題漂移:給一個關於「CRM整合」的源,AI可能生成一篇大談「API設計哲學」的文章,雖然相關,但核心偏離。

- 事實套殼:AI將源內容的事實簡單地用不同句式重組,缺乏深度解讀或額外價值,內容空洞。

- 語氣失調:從一份嚴謹的技術白皮書生成的博客,可能過於學術化;而從一個輕鬆的播客生成的,又可能太隨意。

我們的應對策略是建立「生成模板」和「質量檢查點」。在 SEONIB 中,我們不再只是丟一個連結進去,而是會配置:

- 核心指令:明確要求文章是「操作指南」、「深度分析」、「產品對比」還是「趨勢解讀」。

- 風格錨點:提供一兩篇我們認可的過往文章作為語氣和結構的參考。

- 必含要點:列出必須涵蓋的3-5個關鍵點,確保不偏離主題。

- 排除項:明確不希望出現的競品名稱、過時術語或有爭議的說法。

批量生成前,我們會用3-5個不同類型的源進行小規模測試,人工審核輸出,微調上述配置。這個過程大約需要一兩天的迭代,但一旦調通,後續批量生成數十篇文章的基線質量就有了保障。批量化的核心不是「不干預」,而是「將干預前置和模板化」。

與CMS深度整合:從「發布」到「上線」的最後一步自動化

內容生成好了,更大的麻煩在等著:發布。我們早期使用WordPress,需要手動複製貼上HTML、上傳特色圖片、設定分類標籤、SEO元描述、發布時間……一篇文章從寫完到上線,還要耗費15-20分鐘。對於批量生成的幾十篇文章來說,這是不可接受的時間黑洞。

我們嘗試過一些通用的自動化工具,但針對WordPress、Shopify這類CMS的深度整合往往很脆弱,一個主題更新或插件衝突就能讓整個發布流程中斷。我們需要的是原生、穩定、能理解CMS內容模型的發布能力。

SEONIB 在這點上提供了一個關鍵解決方案:它並非通過模擬前台操作來發布,而是通過CMS的標準API(如WordPress的REST API,Shopify的Admin API)進行整合。這意味著:

- 穩定性高:只要API不變,發布流程就穩定。

- 欄位映射精準:可以準確地將生成內容中的標題、正文、圖片、標籤、分類、SEO標題和描述,映射到CMS後台的對應欄位。

- 支援定時發布:可以輕鬆設定未來數週甚至數月的發布日曆,實現內容矩陣的規律更新。

我們將發布流程設定為:生成後的內容先進入一個「待發布」隊列,由負責人快速瀏覽(重點看開頭結尾和有無明顯錯誤),確認後即可一鍵提交到發布計劃。系統會自動處理圖片上傳、格式轉換、URL設定等所有瑣事。這步整合,真正把內容從「數字文件」變成了「線上資產」,完成了自動化的閉環。

多語言與GEO優化:應對搜索環境碎片化

我們的用戶遍布全球,只做英語內容等於放棄了大部分市場。但傳統多語言本地化成本極高,且週期長。AI翻譯和生成固然快,但早期我們生產出的「多語言內容」只是文字翻譯,缺乏本地搜索優化(GEO),在非英語搜索引擎中表現平平。

這裡涉及一個關鍵認知:2026年的SEO,尤其是針對AI搜索(如Perplexity, Copilot)和本地化搜索,必須包含GEO優化元素。 這意味著內容中需要自然地融入當地常用的搜索句式、本地案例、適用的法規或文化參考。

SEONIB 的「SEO+GEO雙優化」功能在這個場景下發揮了作用。它不僅在生成多語言版本時進行翻譯,還會根據目標語言區域,調整關鍵字的本地化表達,並在文中適當位置插入符合該地區搜索習慣的上下文。例如,一篇關於「數據合規」的文章,生成德語版本時會側重提及GDPR和德國本地監管機構,而生成日語版本則會關聯PIPA和日本企業的常見實踐。

效果是顯著的。我們一些非英語語種的博客頁面,在本地谷歌或Bing上的排名提升速度,比當初純英文內容在Google.com上的提升更快。這背後正是「針對性生成」與「區域性優化」結合的力量。

反思:效率提升後,人的角色是什麼?

將博客生產效率提升10倍後,團隊是不是就沒事幹了?恰恰相反。人的角色發生了根本性轉變:

- 從「作者」變為「策展人與訓練師」:我們的精力不再用於碼字,而是用於尋找和驗證高品質的內容源,設計更聰明的生成指令,以及持續「訓練」和優化我們的自動化流水線。

- 從「執行者」變為「策略與風險管控者」:我們需要制定不同市場、不同產品線的內容策略,並建立最後的質量防線和輿情監控機制(就像文章開頭提到的那次事故,促使我們加強了發布前對特定文化敏感詞的審核流程)。

- 從「內容生產者」變為「效果分析師」:有更多時間分析不同內容源、不同生成模板、不同發布策略帶來的流量、轉化和用戶參與度差異,用數據驅動下一次迭代。

自動化沒有取代我們,而是將我們從重複性勞動中解放出來,讓我們去處理那些更需要判斷力、創造力和戰略思維的工作。 這套以 SEONIB 為核心的自動化流水線,已經成為我們內容運營的基礎設施。它不完美,需要維護和調優,但它提供的穩定產出能力和規模擴展性,是我們能以小團隊管理全球內容矩陣的底氣所在。

FAQ

Q1: 全自動生成內容,谷歌等搜索引擎會懲罰嗎? A: 這是2023年的老問題了。關鍵在於「質量」而非「是否由AI生成」。如果生成內容是低質量、無意義、純粹關鍵字堆砌的,那麼無論是人寫還是AI寫,都會被懲罰。我們的經驗是,只要內容提供了真實價值、信息準確、結構清晰、用戶體驗好,搜索引擎是認可的。我們的自動化流程包含了人工審核和指令優化,以確保內容質量達標。

Q2: 如何保證從影片或競品頁面生成內容不構成侵權? A: 這是個重要的法律和倫理問題。我們的原則是「汲取靈感,而非複製」。自動化工具提取的是核心觀點、事實和邏輯框架,而不是原文照搬。生成的文章會用自己的語言重新組織,並添加我們的獨立分析和見解。我們也會在流程中設置檢查,避免出現大段的直接引用(除非獲得授權)。本質上,這和人類研究員閱讀多份資料後撰寫綜述文章是一樣的。

Q3: 多語言生成內容,本地用戶能感覺到是AI寫的嗎?語言是否地道? A: 早期版本確實有「翻譯腔」問題。但現在先進的模型在本地化方面已經做得很好,尤其是結合了GEO優化後。我們的流程中,對於關鍵市場(如日、德、西),會有母語者進行抽樣審讀,提供反饋並用於優化生成指令。最終效果是,大部分用戶察覺不到是AI生成,尤其是對於信息型、技術型博客。當然,要達到頂級母語寫手的文學性仍不可能,但對於商業和科技內容而言,已完全夠用。

Q4: 這套自動化流程的初始設定和持續維護成本高嗎? A: 初始設定需要投入時間(大約1-2週)來測試不同內容源、調試生成模板、打通CMS整合。這是主要的「一次性成本」。持續維護成本則很低,主要是定期檢查發布日誌、根據內容表現數據微調策略、以及當CMS有重大更新時測試整合穩定性。相比傳統全職寫手團隊的人力成本,這種投入是極低的,且具備極佳的規模效應——管理10個博客和管理100個博客,邊際成本增加很小。

Q5: 自動生成內容,在用戶互動(評論、分享)方面表現如何? A: 這取決於內容本身的價值。我們發現,由深度行業報告或熱門影片生成的、信息密度高、觀點清晰的文章,其用戶互動率(閱讀時長、分享)並不遜於人工撰寫的精品文章。關鍵在於選題和源的質量。自動化並沒有降低內容本身需要具備的價值標準,它只是改變了價值傳遞的生產方式。互動率低的,往往是那些選題平庸、生成指令粗糙的文章,這反過來會促使我們優化上游的「策源」環節。

分享本文